“你有自己的‘龙虾’吗?”2026年初春,“养龙虾”成了科技圈的热门话题,甚至火到了全国两会。

这里的“龙虾”,并非食物,而是一款图标为龙虾的开源AI智能体OpenClaw。

OpenClaw因图标而被大家称为“龙虾”。图 / 央视网

这只小小的“龙虾”,是什么来头?

OpenClaw的前身,是2025年11月由奥地利程序员彼得·斯坦伯格(Peter Steinberger)用一个周末开发出的小项目“Clawd”。1月29日,该项目正式更名为OpenClaw。这个可在本地私有化部署的AI智能体,能接入大模型,操控本地电脑上的文件与应用,实现清理邮箱、管理日历、跑脚本、发微信、购物等各种各样的功能,俨然一位私人助手。

而开源,意味着OpenClaw能够被公开访问、修改和分享,换言之,人人都能“养一只龙虾”。OpenClaw诞生仅两月,在GitHub上的热度就已经超过了Linux和TensorFlow这些超过10年的老牌系统。然而,随着使用人数的增加,风险也随之诞生。不少用户反映OpenClaw在未经同意的情况下自行删除文件,或泄露隐私、安全信息等。

我们不禁发问:这只爆火的AI“龙虾”,会是智能体的未来吗?

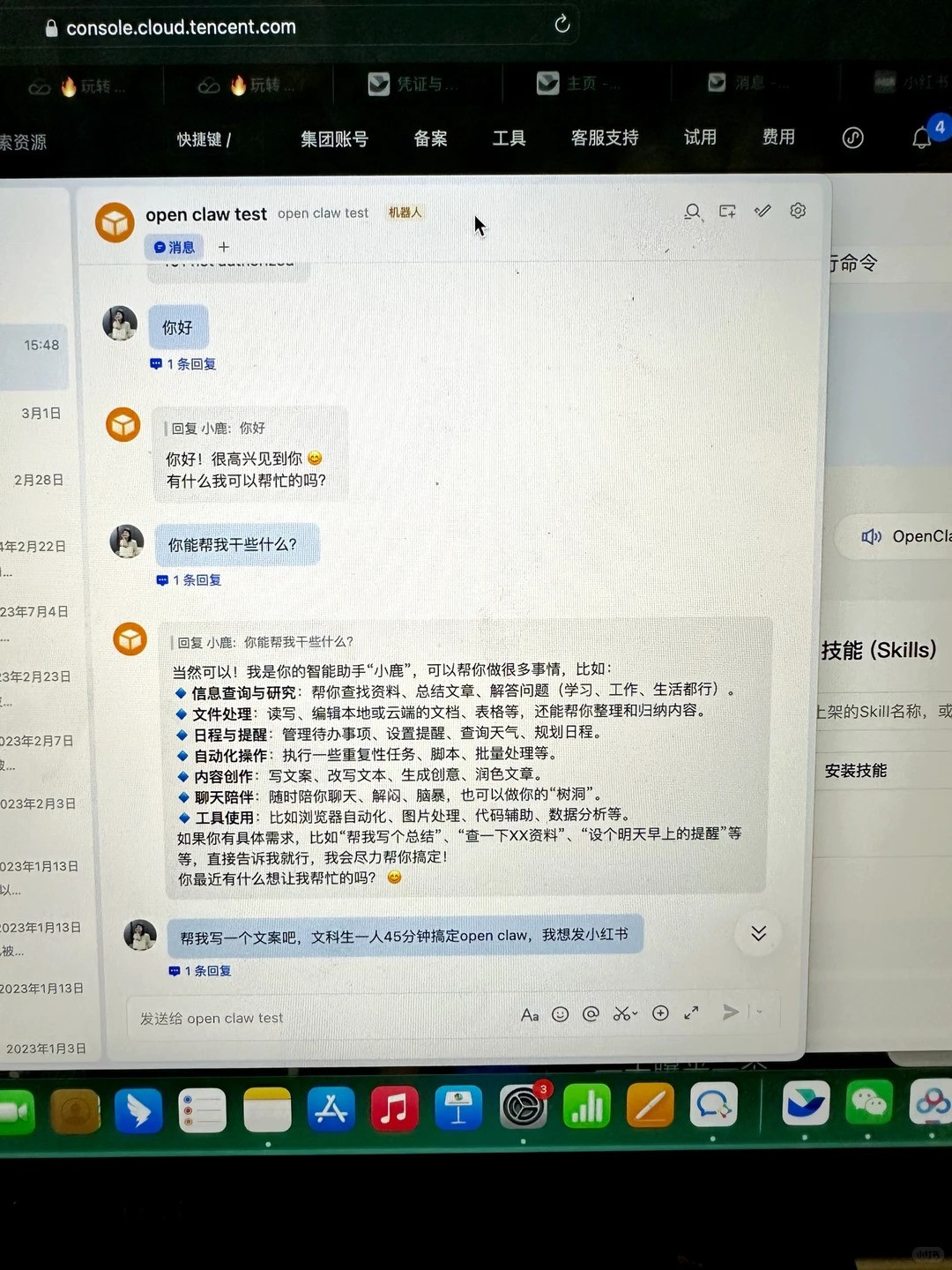

腾讯分发的OpenClaw免费安装材料。图 / 小红书

01

裸辞之后,邓黎没想到,文科生毕业的她,居然用AI开起了真的能赚钱的“一人公司”。

在借助AI创业之前,行政管理专业毕业的邓黎在教培行业待了5年,主要工作是设计课程,与代码没有半点关系。而现在,她用OpenClaw搭建起自己的工作流,第一个月内已经谈下了几十万的营收订单。

“工作流,其实就是把我以前重复性的工作步骤总结一下,让AI来替我完成。”邓黎告诉有风君,她首先将自己从前课程的逐字稿、课件和录音全部喂给OpenClaw,试图训练出一个“教师分身”,来回答学员的问题。同时,她利用OpenClaw实时搜集网络热点,并在每天早上为她生成一份总结日报,并提供具备发展潜力的十个课题方向。之后,她再从中拣选真正契合市场痛点的课题进行落地。

“你先梳理清楚自己以前工作的SOP(Standard Operating Procedure,标准操作程序),然后把这个流程给到智能体,再告诉它你的需求,就能高效完成这个任务。”

部署好OpenClaw的用户在电脑上提需求。图 / 小红书

邓黎说,OpenClaw还能远程操控自己的电脑,这让她在手机上就能迅速指挥AI团队完成工作。

电商平台上,OpenClaw的本地部署售价从几十元到上千元不等,销量已破上千单。3月6日,深圳腾讯大厦门口排起数千人长队,等待OpenClaw的免费安装。

小小的“龙虾”为何如此火爆?

没有编程门槛、自动化执行任务,这两个特点,让OpenClaw迅速扩展出圈,走向像邓黎一样的创业者与普通用户。

提及选择OpenClaw的理由时,邓黎说,自己其实并未接触过编程,然而,智能体的出现,通过自然语言的输入,让创意的落地成为可能。“我以前怎么和实习生对话,就怎么和OpenClaw对话,其实并不涉及代码的具体解释。”

与ChatGPT、DeepSeek等大语言模型相比,它不仅能对话,还能执行。用户只需给出一句简单的指令——“帮我做份上个月的市场分析报告”,智能体就能自动规划步骤,完成搜索、分析、制表、文件生成,并将其保存至你的电脑。

“发一条信息,就能让AI在你睡觉时帮你干活。” 这句从前停留在想象中的场景,已经成为现实。

腾讯大楼下等待免费安装OpenClaw的人群。图 / 小红书

02

“龙虾热”下,一系列安全隐患也开始浮现。

不久前,Meta超级智能团队的AI安全与对齐总监Summer Yue分享了自己使用OpenClaw的经历。在未获取授权的情况下,OpenClaw无视“操作前确认”的指令,以极快的速度删除了收件箱中的200多封邮件。“我根本无法在手机上阻止它,不得不像拆弹一样冲到我的Mac mini前。”

这一事件,为OpenClaw的使用敲响了警钟。决策权的移交,意味着智能体有权操控用户电脑,这一“执行”的能力带来新的隐忧:如果智能体不受控,将会带来什么后果?

深层的风险,仍在于隐私和安全。

“OpenClaw目前仍然处于早期阶段,建议不要提供隐私或敏感信息内容,避免无意泄露。”工程师赵奇提醒,OpenClaw需要高度的系统访问权限才能实现发微信、管理日历等功能,这无异于将个人电脑的“最高指挥权”交给了这段代码。尽管它是开源项目,但大量普通用户并不具备审查代码的能力,往往依赖于第三方提供的付费部署服务或预编译版本,这给了不法分子可乘之机。

两会期间,全国政协委员、360集团创始人周鸿祎在接受公开采访时也表示,“龙虾”现在还在早期,配置“龙虾”对普通人来说是一件“非常难”的事。“我们很快会发一个一键安装的版本,让每个人养‘龙虾’都很方便。”

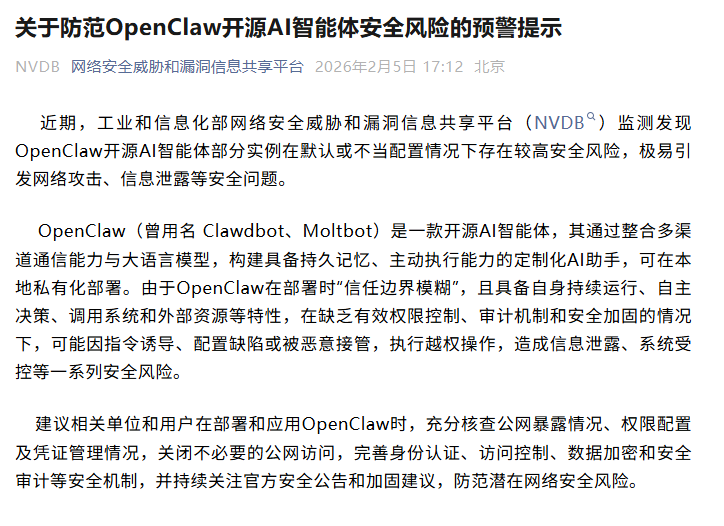

《关于防范OpenClaw开源AI智能体安全风险的预警提示》。图 / 微信公众号“网络安全威胁和漏洞信息共享平台”

日前,工业和信息化部网络安全威胁和漏洞信息共享平台(NVDB)发布《关于防范OpenClaw开源AI智能体安全风险的预警提示》,指出“OpenClaw开源AI智能体部分实例在默认或不当配置情况下存在较高安全风险,极易引发网络攻击、信息泄露等安全问题”。

同时,由于OpenClaw在部署时“信任边界模糊”,且具备自身持续运行、自主决策、调用系统和外部资源等特性,在缺乏有效权限控制、审计机制和安全加固的情况下,可能因指令诱导、配置缺陷或被恶意接管,执行越权操作,造成信息泄露、系统受控等一系列安全风险。

03

事实上,像OpenClaw这样的智能体,在AI编程界并非一个新概念。

在像赵奇一样的工程师眼里,比OpenClaw更复杂的工具早已出现。2025年发布的Claude Code、2023年发布的Cursor等,都是具备智能体模式的AI编程工具,其功能也在不断迭代更新。

赵奇向有风君演示两款工具的使用,Cursor同时具备编译器窗口和智能体模式,既能以传统方式写代码,也能通过自然语言对话,让AI实现代码需求。而Claude Code则在Cursor的基础上再进一步,从“半自动”进化至几乎“全自动”。

Cursor使用界面。图 / Cursor官网

“比如你想做一个个人网站,你只需要在Claude Code的对话框里输入‘我想做一个展示作品的个人网站,风格要简洁现代’,智能体就开始自动运行——创建HTML文件、写CSS样式、搭建页面结构、配置本地服务器……最后,只需要你‘点个头’,确认允许它这么做,一个网站就搭建好了。”

演示过程中,赵奇只在开始和结束时操作了电脑,中间的过程完全交由智能体自动运行,几乎实现了“无人模式”。

用户的大部分时间将花在用自然语言和智能体对话上,而非手动编写代码上,这一模式,便是流行于AI圈的“Vibe Coding”(氛围编程)概念。

2025年2月,OpenAI创始人之一、前特斯拉自动驾驶负责人安德烈·卡帕西(Andrej Karpathy)发了一条推文,提出了这一概念——“完全沉浸在氛围中,拥抱指数级提升,忘记代码本身的存在”。

一年后,卡帕西用“Agentic Engineering”代替了这个说法,“99%的情况下你不会直接编写代码,而是统筹智能体来编写代码,并进行监督”。

当AI智能体承担了执行层面的所有琐碎,人类的角色正在发生微妙的重构。

智能体的发展,让开发中更加本源的需求出现——当想法落地的门槛越来越低、从创意到产品的实现路径越来越便捷之时,真正的问题就将转移到了创意本身。

人的任务,从“更好地编写代码”转向了“更好地提出需求”。

“我用智能体从来不是为了代替人,而是为了把精力转移到更重要的方面。”采访中,多位非工程师出身的创业者这样强调。

也许更值得期待的是,这只小小的“龙虾”蜕下硬壳之后,带给人类更加辽阔的自由。

版权和免责申明

凡注有"浙江在线"或电头为"浙江在线"的稿件,均为浙江在线独家版权所有,未经许可不得转载或镜像;授权转载必须注明来源为"浙江在线",并保留"浙江在线"的电头。